엔비디아(www.nvidia.co.kr, CEO 젠슨 황)가 매그넘(Magnum) IO을 발표했다. 매그넘 IO는 데이터 과학자 및 고성능컴퓨팅(HPC) 연구원들이 엄청난 양의 데이터를 단 몇 분 내에 처리할 수 있도록 지원하는 소프트웨어 제품군이다.

스토리지 및 인풋·아웃풋(I/O) 병목현상 제거에 최적화된 매그넘 IO는 복잡한 금융 분석, 기후 모델링 및 기타 HPC 워크로드를 수행하기 위해 엄청난 양의 데이터 세트로 작업할 시 멀티 서버, 멀티 GPU 컴퓨팅 노드의 데이터 처리 속도를 최대 20배까지 개선한다.

엔비디아는 데이터다이렉트 네트웍스(DataDirect Networks), 엑셀레로(Excelero), IBM, 멜라녹스(Mellanox), 웨카IO(WekaIO) 등을 비롯한 네트워킹 및 스토리지 분야의 업계 선두기업들과 긴밀한 협업을 통해 매그넘IO를 개발했다.

엔비디아 창업자 겸 CEO 젠슨 황은 “대량의 수집된 데이터나 시뮬레이션된 데이터를 처리하는 것은 인공지능(AI)과 같은 데이터 중심 과학의 핵심이다. 데이터의 규모와 속도가 기하급수적으로 증가하면서, 데이터 처리는 데이터센터의 주요 도전과제이자 비용 문제 중 하나로 떠올랐다”고 설명했다.

젠슨 황 CEO는 이어 “초고성능의 컴퓨팅에는 마찬가지로 초고성능의 I/O가 필요하다. 매그넘 IO는 컴퓨팅을 혁신한 엔비디아의 GPU 가속을 I/O 및 스토리지에 제공함으로써 이를 구현한다. 이제 AI 연구진 및 데이터 과학자들은 데이터를 기다릴 필요없이 본연의 핵심 업무에 집중할 수 있게 됐다”고 덧붙였다.

매그넘 IO의 핵심에는 GPU다이렉트(GPUDirect)가 있는데, 이는 데이터가 CPU를 우회하여 GPU, 스토리지 및 네트워킹 디바이스가 제공하는 ‘개방형 고속도로’로 이동할 수 있는 경로를 제공한다. 엔비디아 NV링크(NVLink) 및 NCCL은 물론이고 OpenMPI 및 UCX를 비롯한 다양한 통신 인터커넥트 및 API와 호환되는 GPU다이렉트는 P2P 및 RDMA(Remote Direct Memory Access) 엘리먼트로 구성된다.

가장 최근 추가된 GUP다이렉트 스토리지(GPUDirect Storage) 엘리먼트를 통해 연구원들은 스토리지에 접근할 때 CPU를 우회하고 재빨리 데이터 파일에 접근하여 시뮬레이션이나, 분석 또는 시각화 작업을 수행할 수 있다.

저작권©올포칩 미디어. 무단전재 및 재배포를 금지합니다.

GaN 전력 증폭기를 지원하는 아티슨의 500W 쿼터 브릭 DC-DC 컨버터 모듈업계 표준 쿼터 브릭 형식으로 구성된 AGQ500 시리즈는 피크 효율이 95% 이상이고 36V ~ 75V에 이르는 광범위한 입력 범위를 지원한다. 50V 공칭 출력 모델(AGQ500-48S50)은 BTS(고전력 무선 기지국) 구축에 사용되는 증가하는 GaN 기술을 지원하도록 설계되었다. 이 50V 모델은 최대 10A의 출력 전류를 제공할 수 있다. 알루미늄 베이스 플레이트 구조는 AGQ500 시리즈 모듈에 뛰어난 열 성능을 제공한다. 이 모델은 -40°C에서 85°C 사이의 주변 온도에서 작동할 수 있으며 최대 100°C의 베이스 플레이트 온도에서도 모두 공냉 없이 최대 전력으로 계속 작동할 수 있다.

GaN 전력 증폭기를 지원하는 아티슨의 500W 쿼터 브릭 DC-DC 컨버터 모듈업계 표준 쿼터 브릭 형식으로 구성된 AGQ500 시리즈는 피크 효율이 95% 이상이고 36V ~ 75V에 이르는 광범위한 입력 범위를 지원한다. 50V 공칭 출력 모델(AGQ500-48S50)은 BTS(고전력 무선 기지국) 구축에 사용되는 증가하는 GaN 기술을 지원하도록 설계되었다. 이 50V 모델은 최대 10A의 출력 전류를 제공할 수 있다. 알루미늄 베이스 플레이트 구조는 AGQ500 시리즈 모듈에 뛰어난 열 성능을 제공한다. 이 모델은 -40°C에서 85°C 사이의 주변 온도에서 작동할 수 있으며 최대 100°C의 베이스 플레이트 온도에서도 모두 공냉 없이 최대 전력으로 계속 작동할 수 있다. 시놀로지, 기업의 고성능 데이터 서비스 제공하는 통합 컨트롤러 UC3200 출시새로운 UC3200은 합리적인 총 소유 비용으로 간편한 사용자 인터페이스 갖췄으며 다운타임이 거의 없는 iSCSI 솔루션을 구축하고 서비스 가동 시간을 극대화 할 수 있는 액티브-액티브 IP SAN 솔루션이며, 관리자는 직관적인 운영 체제를 통해 단일 포털에서 두 개의 컨트롤러를 관리할 수 있으므로 어려운 학습 과정 없이도 편리하게 관리할 수 있다

시놀로지, 기업의 고성능 데이터 서비스 제공하는 통합 컨트롤러 UC3200 출시새로운 UC3200은 합리적인 총 소유 비용으로 간편한 사용자 인터페이스 갖췄으며 다운타임이 거의 없는 iSCSI 솔루션을 구축하고 서비스 가동 시간을 극대화 할 수 있는 액티브-액티브 IP SAN 솔루션이며, 관리자는 직관적인 운영 체제를 통해 단일 포털에서 두 개의 컨트롤러를 관리할 수 있으므로 어려운 학습 과정 없이도 편리하게 관리할 수 있다 리미니스트리트, 전세계 고객 대상 SAP 기업용 솔루션을 위한 ‘애플리케이션 관리 서비스(AMS)’ 발표이제 고객들은 기존 고비용, 저가치의 연간 지원 서비스를 대체할 수 있는 리미니스트리트의 SAP 지원 서비스뿐만 아니라, 리미니스트리트 AMS(애플리케이션 관리 서비스)를 함께 사용하여 ‘SAP 애플리케이션의 관리 및 지원 서비스’로 통합함으로써, SAP 라이센스 사용자들이 IT 운영을 단순화하여 업무 효율성을 높이고, 혁신에 집중할 수 있는 리소스를 확보하며 더 나은 비즈니스 성과를 얻을 수 있다.

리미니스트리트, 전세계 고객 대상 SAP 기업용 솔루션을 위한 ‘애플리케이션 관리 서비스(AMS)’ 발표이제 고객들은 기존 고비용, 저가치의 연간 지원 서비스를 대체할 수 있는 리미니스트리트의 SAP 지원 서비스뿐만 아니라, 리미니스트리트 AMS(애플리케이션 관리 서비스)를 함께 사용하여 ‘SAP 애플리케이션의 관리 및 지원 서비스’로 통합함으로써, SAP 라이센스 사용자들이 IT 운영을 단순화하여 업무 효율성을 높이고, 혁신에 집중할 수 있는 리소스를 확보하며 더 나은 비즈니스 성과를 얻을 수 있다. 엔비디아, 마이크로소프트 애저(Azure)에서 구동되는 새로운 GPU 가속 슈퍼컴퓨터 공개가장 까다로운 인공지능(AI) 및 고성능 컴퓨팅(HPC) 애플리케이션을 처리하도록 설계된 애저의 새로운 NDv2 인스턴스는 세계에서 가장 빠른 슈퍼컴퓨터 중 하나로, 단일 멜라녹스 인피니밴드(Mellanox InfiniBand) 백엔드 네트워크에서 상호 연결된 최대 800개의 엔비디아 V100 텐서 코어(Tensor Core) GPU를 제공한다.

엔비디아, 마이크로소프트 애저(Azure)에서 구동되는 새로운 GPU 가속 슈퍼컴퓨터 공개가장 까다로운 인공지능(AI) 및 고성능 컴퓨팅(HPC) 애플리케이션을 처리하도록 설계된 애저의 새로운 NDv2 인스턴스는 세계에서 가장 빠른 슈퍼컴퓨터 중 하나로, 단일 멜라녹스 인피니밴드(Mellanox InfiniBand) 백엔드 네트워크에서 상호 연결된 최대 800개의 엔비디아 V100 텐서 코어(Tensor Core) GPU를 제공한다. 인피니언, 전자신분증의 빠른 개발을 지원하는 SECORA ID 솔루션 출시플러그-앤-플레이 방식의 SECORA ID 솔루션은 업계를 선도하는 인피니언의 보안칩에 소프트웨어를 결합하여 고도의 보안이 요구되는 전자신분증에 쉽게 통합된다. 국가 전자신분증 및 기타 애플리케이션의 특정 요구 사항에 따라 쉽고 효율적으로 맞춤화할 수 있다. 기타 애플리케이션은 전자 의료보험 카드와 전자 운전면허증에서부터 신분증과 결제, 대중 교통 티켓팅 기능을 결합한 다기능 솔루션에 이르기까지 다양하다.

인피니언, 전자신분증의 빠른 개발을 지원하는 SECORA ID 솔루션 출시플러그-앤-플레이 방식의 SECORA ID 솔루션은 업계를 선도하는 인피니언의 보안칩에 소프트웨어를 결합하여 고도의 보안이 요구되는 전자신분증에 쉽게 통합된다. 국가 전자신분증 및 기타 애플리케이션의 특정 요구 사항에 따라 쉽고 효율적으로 맞춤화할 수 있다. 기타 애플리케이션은 전자 의료보험 카드와 전자 운전면허증에서부터 신분증과 결제, 대중 교통 티켓팅 기능을 결합한 다기능 솔루션에 이르기까지 다양하다.- 마이크로소프트 애저, 금융 클라우드 안전성 평가 완료한국마이크로소프트는 올해 1월 개정된 ‘전자금융감독규정’ 및 ‘금융분야 클라우드 컴퓨팅 서비스 이용 가이드’에 따라 국내 최초 디지털 손해보험사인 캐롯손해보험의 요청으로 금융보안원과 함께 애저에 대한 안전성 평가를 완료했다. 이로써 캐롯손해보험은 국내 금융사로는 처음으로 전사 IT 시스템을 애저 상에서 운영할 예정이다.

엔비디아, 글로벌 기술기업들과 슈퍼컴퓨터 아키텍처용 GPU 가속 Arm 서버 구축엔비디아 는 슈퍼컴퓨팅 컨퍼런스(SC19)에서 하드웨어 및 소프트웨어 빌딩블록으로 구성된 새로운 레퍼런스 설계 플랫폼은 HPC 업계에서 보다 다양한 CPU 아키텍처를 활용하고자 하는 요구를 충족시키기 위해 개발됐다고 소개했다. 슈퍼컴퓨팅 센터, 하이퍼스케일-클라우드 업체 및 기업들은 이 새로운 레퍼런스 설계 플랫폼을 통해 엔비디아의 가속 컴퓨팅 플랫폼과 최신 Arm 기반 서버 플랫폼의 이점을 모두 누릴 수 있다.

엔비디아, 글로벌 기술기업들과 슈퍼컴퓨터 아키텍처용 GPU 가속 Arm 서버 구축엔비디아 는 슈퍼컴퓨팅 컨퍼런스(SC19)에서 하드웨어 및 소프트웨어 빌딩블록으로 구성된 새로운 레퍼런스 설계 플랫폼은 HPC 업계에서 보다 다양한 CPU 아키텍처를 활용하고자 하는 요구를 충족시키기 위해 개발됐다고 소개했다. 슈퍼컴퓨팅 센터, 하이퍼스케일-클라우드 업체 및 기업들은 이 새로운 레퍼런스 설계 플랫폼을 통해 엔비디아의 가속 컴퓨팅 플랫폼과 최신 Arm 기반 서버 플랫폼의 이점을 모두 누릴 수 있다. 마우저, '목적있는 시제품 제작' 전자책 발간새로 발행되는 목적 있는 시제품 제작(Prototyping with Purpose) 전자책에는 마이크로칩 테크놀로지(Microchip Technology)의 ‘메이크의 마법사’(Wizard of Make) 밥 마틴(Bob Martin) 수석 엔지니어 같은 기술 전문가들이 성공적인 시제품 제작에 이상적인 공간, 하드웨어, 소프트웨어를 심도 있게 살펴본다.

마우저, '목적있는 시제품 제작' 전자책 발간새로 발행되는 목적 있는 시제품 제작(Prototyping with Purpose) 전자책에는 마이크로칩 테크놀로지(Microchip Technology)의 ‘메이크의 마법사’(Wizard of Make) 밥 마틴(Bob Martin) 수석 엔지니어 같은 기술 전문가들이 성공적인 시제품 제작에 이상적인 공간, 하드웨어, 소프트웨어를 심도 있게 살펴본다. 피보탈코리아, ‘Pivotal Summit 2019’ 개최전 세계 엔터프라이즈 소프트웨어의 80% 이상이 스프링으로 개발되고 있고, 이런 문화와 방법론의 혁신을 이끌고 있는 피보탈은 소프트웨어 중심 기업(Software-driven business)으로 변화와 디지털 트랜스포메이션을 준비하고 있는 기업의 경영진 및 리더들, 클라우드 아키텍처, 레거시 및 애플리케이션의 현대화에 대한 과제를 안고 있는 조직의 매니저 및 개발자, 운영자, 아키텍처, 데이터 사이언티스트를 대상으로 이번 서밋을 마련하였다.

피보탈코리아, ‘Pivotal Summit 2019’ 개최전 세계 엔터프라이즈 소프트웨어의 80% 이상이 스프링으로 개발되고 있고, 이런 문화와 방법론의 혁신을 이끌고 있는 피보탈은 소프트웨어 중심 기업(Software-driven business)으로 변화와 디지털 트랜스포메이션을 준비하고 있는 기업의 경영진 및 리더들, 클라우드 아키텍처, 레거시 및 애플리케이션의 현대화에 대한 과제를 안고 있는 조직의 매니저 및 개발자, 운영자, 아키텍처, 데이터 사이언티스트를 대상으로 이번 서밋을 마련하였다. 메이커봇, 나일론 재료 출시 통해 ‘메소드’ 플랫폼 확대나일론은 우수한 탄력성, 높은 인장 및 충격 강도를 자랑한다. 따라서 제조 도구, 고정장치, 연결 부품, 스냅핏, 힌지, 기어, 공기 흡입구와 같은 반복적인 움직임이나 힘을 가하는 용도에 적합하다. 이러한 부품들은 마찰로 인해 열이 높아지는 경우가 많으며 다른 부품과의 접촉으로 인해 높은 유연성을 필요로 한다. 나일론은 우수한 열 특성을 갖춰 최대 180°C 고온의 내열성을 지원한다.

메이커봇, 나일론 재료 출시 통해 ‘메소드’ 플랫폼 확대나일론은 우수한 탄력성, 높은 인장 및 충격 강도를 자랑한다. 따라서 제조 도구, 고정장치, 연결 부품, 스냅핏, 힌지, 기어, 공기 흡입구와 같은 반복적인 움직임이나 힘을 가하는 용도에 적합하다. 이러한 부품들은 마찰로 인해 열이 높아지는 경우가 많으며 다른 부품과의 접촉으로 인해 높은 유연성을 필요로 한다. 나일론은 우수한 열 특성을 갖춰 최대 180°C 고온의 내열성을 지원한다. KT, 5G 기반 의료영상 솔루션에 AI 기술 적용KT는 국내 3D 의료영상 소프트웨어 개발사인 코어라인소프트와 5G 의료융합 유스케이스 발굴을 위한 전략적 협력을 체결했다. 코어라인소프트는 AI 의료영상 분석 기술을 보유하고 있다. 3D 의료영상 협업플랫폼을 개발하는 회사로 CT 촬영이후 판독을 지원하는 소프트웨어 ‘에이뷰 스크리닝’을 개발했다. 이번 업무협약에 따라 KT와 코어라인소프트는 초저지연 5G 기반 의료용 3D VR 수술가이드 개발, 의료용 3D영상 협업솔루션 고도화 개발, 5G 플랫폼 기반 의료 산업 협업 생태계 구축, 5G 의료영상 콘텐츠 개발 및 확보 등을 추진할 계획이다.

KT, 5G 기반 의료영상 솔루션에 AI 기술 적용KT는 국내 3D 의료영상 소프트웨어 개발사인 코어라인소프트와 5G 의료융합 유스케이스 발굴을 위한 전략적 협력을 체결했다. 코어라인소프트는 AI 의료영상 분석 기술을 보유하고 있다. 3D 의료영상 협업플랫폼을 개발하는 회사로 CT 촬영이후 판독을 지원하는 소프트웨어 ‘에이뷰 스크리닝’을 개발했다. 이번 업무협약에 따라 KT와 코어라인소프트는 초저지연 5G 기반 의료용 3D VR 수술가이드 개발, 의료용 3D영상 협업솔루션 고도화 개발, 5G 플랫폼 기반 의료 산업 협업 생태계 구축, 5G 의료영상 콘텐츠 개발 및 확보 등을 추진할 계획이다. 콘티넨탈 오토모티브 시스템, 비테스코 테크놀로지스 브랜드로 새롭게 출범콘티넨탈 오토모티브 시스템(대표 문태윤)이 ‘비테스코 테크놀로지스(Vitesco Technologies)’ 브랜드로 새롭게 출범한다. 콘티넨탈은 시대의 변화 속에서 급변하는 차량 구동시스템의 요구에 부응하고자 2019년 1월부터 구동 사업본부를 별도 법인으로 분사하였다. 아울러 10월부터 사명을 ‘비테스코 테크놀로지스’로 바꾼 새로운 브랜드로 출범하여 완전히 독립적으로 경영하고 있으며 현재 독일 레겐스부르크(Regensburg)에 본사를 두고 전 세계 50여개 사업장에서 새로운 브랜드 아이덴티티를 발표하고 있다.

콘티넨탈 오토모티브 시스템, 비테스코 테크놀로지스 브랜드로 새롭게 출범콘티넨탈 오토모티브 시스템(대표 문태윤)이 ‘비테스코 테크놀로지스(Vitesco Technologies)’ 브랜드로 새롭게 출범한다. 콘티넨탈은 시대의 변화 속에서 급변하는 차량 구동시스템의 요구에 부응하고자 2019년 1월부터 구동 사업본부를 별도 법인으로 분사하였다. 아울러 10월부터 사명을 ‘비테스코 테크놀로지스’로 바꾼 새로운 브랜드로 출범하여 완전히 독립적으로 경영하고 있으며 현재 독일 레겐스부르크(Regensburg)에 본사를 두고 전 세계 50여개 사업장에서 새로운 브랜드 아이덴티티를 발표하고 있다.- 마이크로소프트, 서울대와 AI 연구 협력 관계 구축서울대학교 오세정 총장은 마이크로소프트 창업자 빌 게이츠의 지난 2013년 서울대학교 방문 및 강연을 언급하며, 양 기관의 인연이 앞으로도 지속적인 교류와 협력으로 이어지기를 희망한다고 말했다. 오 총장은 특히 AI연구원, 낙성 벤처 밸리, 데이터사이언스대학원 등 서울대학교 AI 분야의 성과와 비전을 공유하며, 해당 분야에서의 긴밀한 연구 협력 관계 구축에 대해 논의했다.

- 마우저, 최신제품 384종 추가 및 공급마우저 일렉트로닉스는 신제품 소개(NPI) 부문을 주도하는 유통기업이다. 마우저 일렉트로닉스는 제조사 약 800곳이 생산하는 최신 제품을 공급하고 신기술을 제공하는 것을 제일 중요한 가치로 삼고 고객이 첨단 부품을 이용해 제품 출시 시간을 단축할 수 있도록 지원한다.

로지텍, 미니멀 라이프를 즐기자: ‘미니멀테리어’에 최적화된 추천 아이템 3

로지텍, 미니멀 라이프를 즐기자: ‘미니멀테리어’에 최적화된 추천 아이템 3 마이크로칩, 임베디드 보안 기능을 간단하게 통합할 수 있는 32비트 마이크로컨트롤러 출시

마이크로칩, 임베디드 보안 기능을 간단하게 통합할 수 있는 32비트 마이크로컨트롤러 출시 한국마이크로소프트, AI 기술의 미래 조명하는 ‘AI Tour in Seoul’ 개최

한국마이크로소프트, AI 기술의 미래 조명하는 ‘AI Tour in Seoul’ 개최 미루웨어, 국제인공지능대전(AI EXPO) 2024 참가

미루웨어, 국제인공지능대전(AI EXPO) 2024 참가 플리어의 T5xx 전문가용 열화상 카메라, 전기시설 점검을 위한 필수 장비로 활용

플리어의 T5xx 전문가용 열화상 카메라, 전기시설 점검을 위한 필수 장비로 활용

- 델 테크놀로지스 보고서, 생성형 AI가 기업의 성과 창출에 기여

- KT, 안전 플랫폼 ‘올 인 세이프티’ 도입으로 AI 기반 안전 관리 기능 강화

- 페펄앤드푹스, Ethernet-APL 기반의 액티브 인프라 지원

- NCH코리아, 산업 윤활관리 프로그램 런칭

- 로지텍, ‘시그니처 슬림’ 시리즈로 뛰어난 멀티 디바이스 경험 제공

- 마우저, 인텔의 새로운 독립 FPGA 기업인 알테라 제품 공급

그래픽 / 영상

지멘스 EDA, 최첨단 SoC 설계를 위한 혁신적인 에뮬레이션 및 프로토타이핑 솔루션 발표

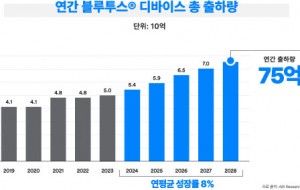

지멘스 EDA, 최첨단 SoC 설계를 위한 혁신적인 에뮬레이션 및 프로토타이핑 솔루션 발표 블루투스 지원 기기 출하량, 향후 5년 동안 연평균 8% 성장 전망

블루투스 지원 기기 출하량, 향후 5년 동안 연평균 8% 성장 전망 인터넷의 ‘필터 버블(Filter Bubble)’ 깨부수기

인터넷의 ‘필터 버블(Filter Bubble)’ 깨부수기

많이 본 뉴스

로데슈바르즈, 최대 50GHz까지 VCO 측정 및 위상 노이즈 분석을 지원하는 R&S FSPN50 출시

로데슈바르즈, 최대 50GHz까지 VCO 측정 및 위상 노이즈 분석을 지원하는 R&S FSPN50 출시 웨스턴디지털, 차세대 QLC 성능 지원하는 SSD 공개

웨스턴디지털, 차세대 QLC 성능 지원하는 SSD 공개 로데슈바르즈, 획기적인 성능으로 무장한 R&S NGC100 파워 서플라이 제품군 신규 출시

로데슈바르즈, 획기적인 성능으로 무장한 R&S NGC100 파워 서플라이 제품군 신규 출시 마이크로소프트, AI 기반 통합 보안 솔루션 ‘코파일럿 포 시큐리티’ 공개

마이크로소프트, AI 기반 통합 보안 솔루션 ‘코파일럿 포 시큐리티’ 공개 엔비디아, cuPQC 소프트웨어로 포스트 양자 암호 촉진

엔비디아, cuPQC 소프트웨어로 포스트 양자 암호 촉진 TI, 임베디드 월드2024에서 스마트하고 지속 가능한 미래를 위한 기술 소개

TI, 임베디드 월드2024에서 스마트하고 지속 가능한 미래를 위한 기술 소개 로지텍, 일렉트로마트 스타필드수원점에 신규 브랜드존 오픈

로지텍, 일렉트로마트 스타필드수원점에 신규 브랜드존 오픈 산업 현장과 클라우드 연결을 지원하는 에머슨의 새로운 견고한 컴팩트 PC

산업 현장과 클라우드 연결을 지원하는 에머슨의 새로운 견고한 컴팩트 PC 팔로알토 네트웍스, 박상규 지사장 선임

팔로알토 네트웍스, 박상규 지사장 선임 엔비디아 옴니버스, 차세대 데이터센터 구축 위한 디지털 청사진 공개

엔비디아 옴니버스, 차세대 데이터센터 구축 위한 디지털 청사진 공개